「教育現場で生成AIを使う際、文科省ガイドラインを踏まえた運用ルールが分からない」――本記事は、文科省「生成AIの利活用に関するガイドラインVer.2.0」(2024-12-26)の要点を、個人講師・スクール運営者向けに整理します。

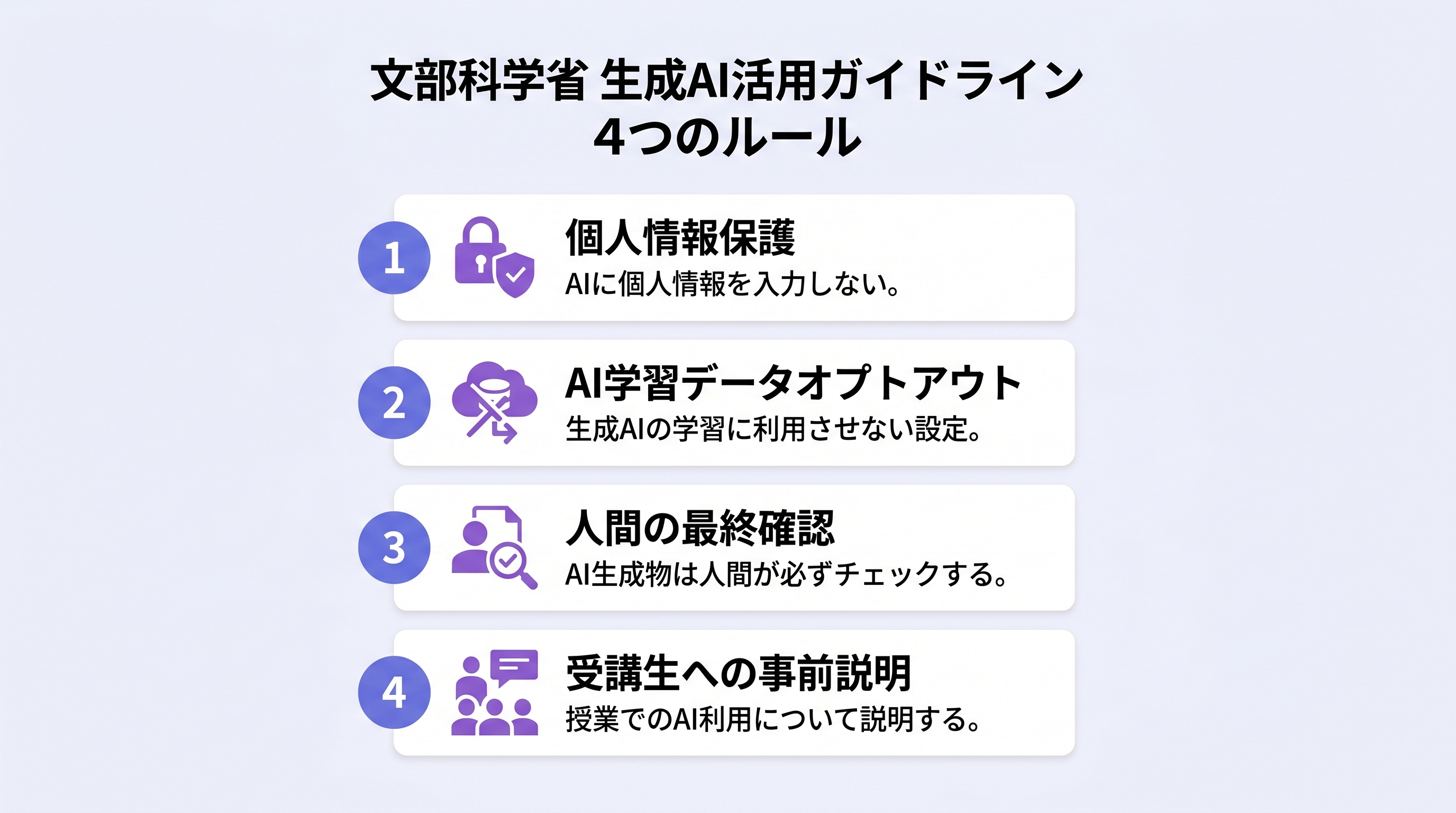

結論から言うと、「個人情報保護・AI学習データのオプトアウト・人間の最終確認・受講生への事前説明」の4点を押さえれば基本準拠できます。

押さえるべき4ルール

- 個人情報保護:受講生の本名・住所・電話番号をAIに入力しない

- AI学習データオプトアウト:ChatGPT設定で「Improve the model」OFF

- 人間の最終確認:AI生成内容は必ず講師がチェック

- 受講生への事前説明:AI活用方針の同意取得

実務での対応

| シーン | 対応 |

|---|---|

| 受講生レポートの添削 | 本名・個人情報を削除してから投入 |

| カスタムGPT配布 | 「個人情報入力禁止」を明記 |

| 学習ロードマップ作成 | 匿名化データで作成 |

FAQ

Q1. 違反したらどうなる?

A. 文科省ガイドラインは法的拘束力はないが、違反時のトラブルは個人情報保護法違反に発展する恐れ。個人情報は必ず削除・匿名化。

次のステップ

関連:AI生成コンテンツの著作権、ChatGPT教育活用大全。

まとめ

文科省ガイドラインVer.2.0の4ルールを押さえれば、教育現場でのAI活用は安全に運用できます。